07/03/2026

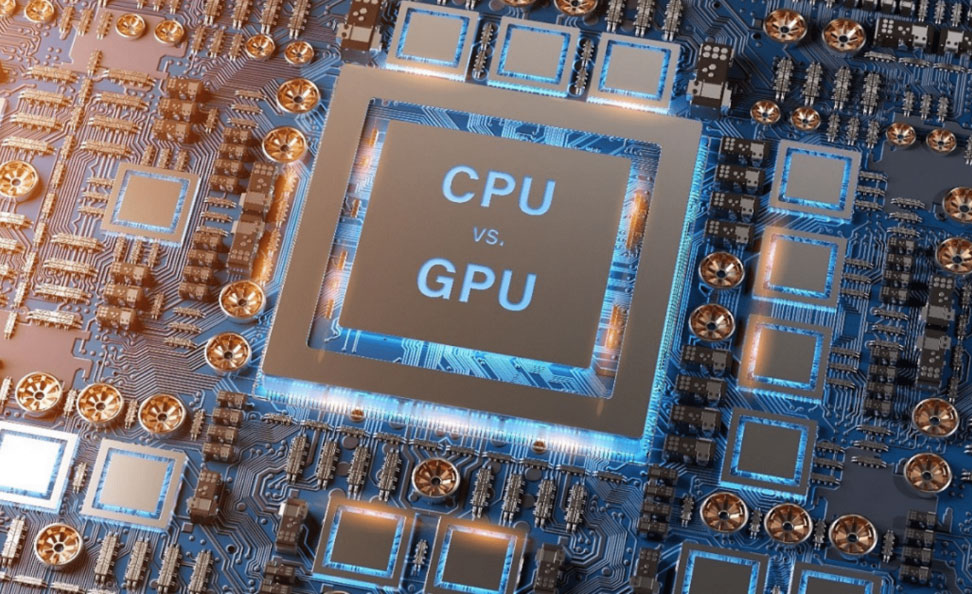

CPU vs GPU vs TPU vs NPU: Doanh nghiệp nên chọn kiến trúc tính toán nào cho AI?

Khi AI ngày càng thâm nhập sâu vào hạ tầng doanh nghiệp và hệ thống cloud-native mở rộng nhanh chóng, việc lựa chọn đúng kiến trúc xử lý không còn là câu chuyện kỹ thuật thuần túy. Đó là một quyết định chiến lược ảnh hưởng trực tiếp đến hiệu năng, chi phí và khả năng mở rộng dài hạn. Vậy CPU, GPU, TPU và NPU khác nhau ở đâu và nên sử dụng trong trường hợp nào?

Vì sao kiến trúc tính toán ngày càng quan trọng?

Trước đây, phần lớn hệ thống CNTT vận hành chủ yếu trên CPU. Tuy nhiên, sự bùng nổ của AI, machine learning và xử lý dữ liệu lớn đã tạo ra những mô hình tính toán hoàn toàn khác. Nhu cầu song song hóa, huấn luyện mô hình khổng lồ và suy luận thời gian thực buộc doanh nghiệp phải cân nhắc kỹ hơn về phần cứng nền tảng.

Mỗi loại bộ xử lý được thiết kế để phục vụ một kiểu workload riêng. Hiểu rõ bản chất của từng kiến trúc sẽ giúp tối ưu tài nguyên thay vì đầu tư dàn trải và kém hiệu quả.

CPU: Bộ não điều phối hệ thống

CPU là bộ xử lý đa mục đích và vẫn giữ vai trò trung tâm trong mọi hệ thống. Điểm mạnh của CPU nằm ở khả năng xử lý tuần tự và các tác vụ nhiều nhánh rẽ, đòi hỏi phản hồi nhanh với độ trễ thấp.

Trong môi trường doanh nghiệp, CPU thường đảm nhiệm:

Quản lý hệ điều hành và điều phối tài nguyên

Xử lý API và hệ thống giao dịch

Thực thi logic điều khiển control-plane

CPU không mạnh về tính toán song song quy mô lớn, nhưng lại cực kỳ linh hoạt và phù hợp cho các tác vụ điều phối.

GPU: Sức mạnh song song cho AI và dữ liệu lớn

Khác với CPU, GPU được thiết kế để xử lý hàng nghìn phép toán cùng lúc. Nhờ số lượng lõi lớn và kiến trúc song song, GPU đặc biệt phù hợp với các phép toán ma trận và vector hóa, vốn là nền tảng của deep learning.

GPU thường được sử dụng trong:

Huấn luyện mô hình AI

Phân tích dữ liệu lớn

Tính toán khoa học và mô phỏng

Dựng hình và xử lý đồ họa

GPU đánh đổi hiệu năng đơn luồng để đạt thông lượng xử lý cực cao. Đây là nền tảng chủ lực của hạ tầng AI hiện nay.

TPU: Tối ưu chuyên biệt cho huấn luyện AI

TPU là chip chuyên dụng được thiết kế riêng cho các phép toán tensor trong mạng nơ-ron. Không giống CPU hay GPU mang tính đa mục đích, TPU tập trung tối đa vào hiệu suất huấn luyện mô hình AI quy mô lớn.

TPU thường được triển khai trong môi trường cloud và các trung tâm dữ liệu chuyên AI. Nhờ tối ưu sâu cho các định dạng như FP16, BF16 hay tính toán lượng tử hóa, TPU đạt hiệu suất cao trên mỗi watt tiêu thụ điện.

Điểm đánh đổi là TPU kém linh hoạt hơn khi xử lý các workload ngoài AI.

NPU: AI trên thiết bị biên

Nếu GPU và TPU phục vụ huấn luyện mô hình trong data center, thì NPU lại hướng đến suy luận AI ở thiết bị biên. Đây là bộ tăng tốc chuyên xử lý mô hình đã được huấn luyện, với mục tiêu tiêu thụ điện thấp và phản hồi thời gian thực.

NPU thường xuất hiện trong:

Smartphone

Thiết bị IoT

Camera thông minh

Hệ thống nhúng

Nhờ NPU, các tác vụ như nhận diện khuôn mặt, xử lý giọng nói hay thị giác máy tính có thể chạy trực tiếp trên thiết bị mà không cần gửi dữ liệu về cloud.

Doanh nghiệp nên chọn kiến trúc nào?

Không có kiến trúc nào là tối ưu cho mọi trường hợp. Lựa chọn đúng phụ thuộc vào mục tiêu sử dụng:

CPU phù hợp cho điều phối và hệ thống nghiệp vụ

GPU phù hợp cho xử lý song song và huấn luyện AI

TPU phù hợp cho huấn luyện AI quy mô rất lớn trong môi trường chuyên dụng

NPU phù hợp cho suy luận AI tại thiết bị biên

Trong bối cảnh AI ngày càng được tích hợp vào mọi lớp hạ tầng, thiết kế hệ thống hiện đại không chỉ là tối ưu phần mềm mà còn là bài toán căn chỉnh workload với đúng kiến trúc phần cứng. Hiểu rõ sự khác biệt giữa CPU, GPU, TPU và NPU giúp doanh nghiệp đầu tư đúng ngay từ đầu, tối ưu chi phí và sẵn sàng cho các bước mở rộng trong tương lai.