07/03/2026

TORmem AI Edge Systems: Hiệu năng Inference cấp doanh nghiệp không cần hạ tầng quá mức

AI inference đang dịch chuyển từ trung tâm dữ liệu về gần nơi dữ liệu được tạo ra. Doanh nghiệp, bệnh viện, phòng nghiên cứu và các đội AI nội bộ ngày nay không còn muốn triển khai những hệ thống GPU cỡ lớn vốn được thiết kế cho training chỉ để phục vụ suy luận. Điều họ cần là hiệu năng mạnh mẽ, bộ nhớ lớn, độ trễ ổn định và khả năng triển khai nhanh, trong một kiến trúc gọn gàng và hiệu quả.

Trong bối cảnh đó, TORmem AI Edge Systems mang đến một cách tiếp cận khác biệt, tập trung vào nhu cầu inference thực tế thay vì chạy theo thông số đỉnh lý thuyết.

Bài toán của hệ thống GPU truyền thống

Phần lớn nền tảng GPU hiện đại được xây dựng xoay quanh mục tiêu training AI quy mô lớn. Điều này dẫn tới một số hệ quả khi áp dụng cho inference:

- Yêu cầu cấu hình nhiều GPU ngay từ mức tối thiểu

• Tiêu thụ điện năng và làm mát cao

• Chu kỳ triển khai dài và phức tạp

• Kiến trúc bộ nhớ phụ thuộc chặt vào giới hạn GPU

Với khách hàng thiên về inference, đây thường là sự phân bổ tài nguyên vượt nhu cầu thực tế, làm tăng chi phí đầu tư và vận hành.

Triết lý thiết kế của TORmem: Lấy bộ nhớ làm trung tâm

TORmem lựa chọn một hướng đi khác. Thay vì tối ưu cho training quy mô hyperscale, hệ thống được thiết kế tập trung vào inference thực tiễn trong môi trường doanh nghiệp.

Điểm cốt lõi nằm ở kiến trúc memory-centric:

- Tách khả năng mở rộng bộ nhớ khỏi giới hạn phần cứng GPU

• Đảm bảo độ ổn định cấp doanh nghiệp trong thiết kế nhỏ gọn

• Duy trì hiệu năng nhất quán trên workload thực tế

Cách tiếp cận này giúp hệ thống tối ưu cho những gì khách hàng thực sự sử dụng trong production, thay vì chỉ tối ưu cho benchmark.

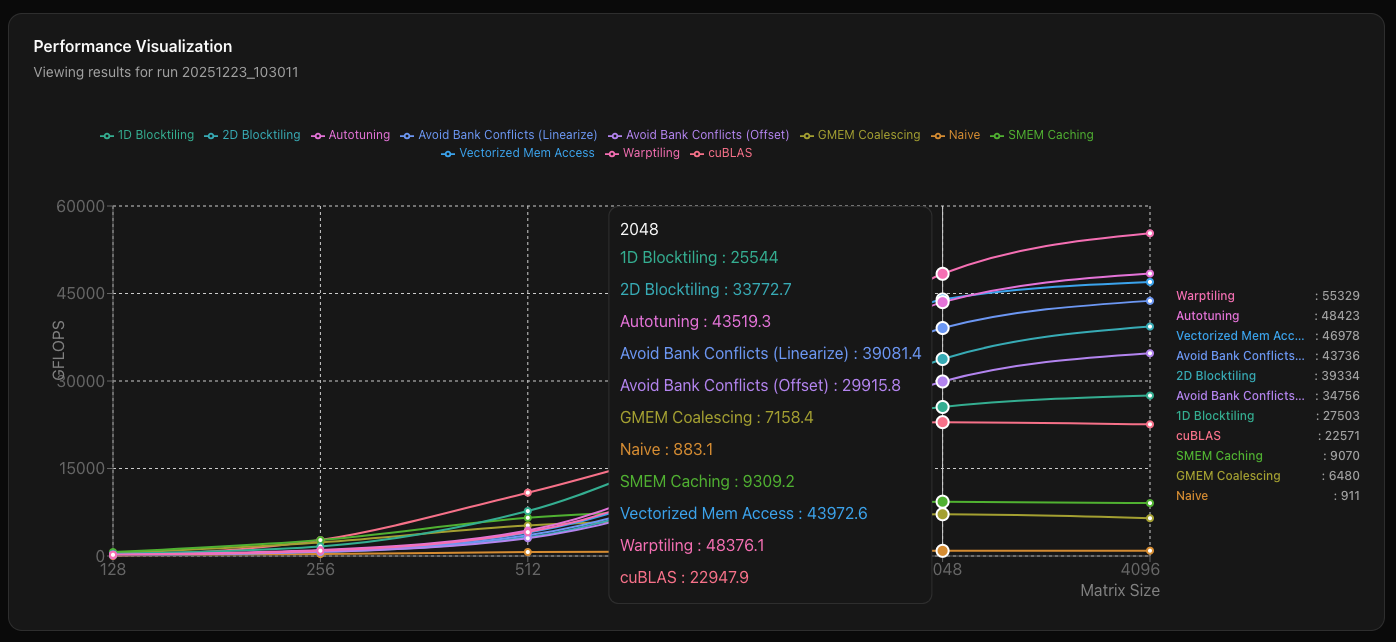

Hiệu năng đo bằng thực tế, không chỉ bằng thông số

Hiệu năng inference không được quyết định bởi con số peak đơn lẻ. Điều quan trọng là throughput sử dụng được và độ trễ ổn định trong điều kiện tải liên tục.

TORmem AI Edge Systems được xác thực hoạt động trong cùng phân khúc hiệu năng inference như các GPU trung tâm dữ liệu hiện đại thường dùng cho suy luận. Tuy nhiên, hệ thống tránh được gánh nặng vận hành và độ phức tạp kiến trúc vốn đi kèm các nền tảng training truyền thống.

Thay vì tập trung vào lý thuyết, TORmem chú trọng vào hiệu năng phù hợp với workload thực tế trong môi trường production.

Khi bộ nhớ trở thành yếu tố quyết định

Khi mô hình AI ngày càng lớn và pipeline inference trở nên phức tạp, hành vi bộ nhớ ngày càng đóng vai trò trung tâm trong hiệu năng tổng thể.

Kiến trúc của TORmem cho phép:

- Hỗ trợ mô hình lớn mà không gây áp lực lên bộ nhớ GPU

• Ổn định với workload long-context và mixture-of-experts

• Duy trì độ trễ dự đoán được dưới tải cao

• Tối ưu hóa mức sử dụng tài nguyên tính toán

Bằng cách coi bộ nhớ là tài nguyên chiến lược của hệ thống, TORmem duy trì hiệu năng suy luận cao mà không cần mở rộng GPU quá mức.

Thiết kế cho triển khai AI thực tế

TORmem AI Edge Systems được xây dựng cho những môi trường đặt nặng hiệu quả, độ tin cậy và tốc độ triển khai:

- Hệ thống AI y tế và chăm sóc sức khỏe

• Nền tảng AI riêng trong doanh nghiệp

• Triển khai inference tại edge hoặc on-premise

• Phòng nghiên cứu và AI ứng dụng

Đây là các môi trường yêu cầu hệ thống mạnh, tiêu thụ điện hợp lý, vận hành ổn định và sẵn sàng cho production.

Giá trị TORmem mang lại

TORmem AI Edge Systems đại diện cho:

- Hiệu năng inference cấp doanh nghiệp

• Hoạt động trong cùng phân khúc suy luận với nền tảng H100/H200

• Tránh phân bổ tài nguyên GPU vượt nhu cầu

• Cho phép triển khai workload AI bộ nhớ lớn tại edge

Hệ thống không nhằm thay thế các cụm training hyperscale. Thay vào đó, TORmem được thiết kế cho những tổ chức cần hiệu năng phù hợp, triển khai hiệu quả và tối ưu cho inference thực tế.

TORmem AI Edge Systems chứng minh rằng AI inference cấp doanh nghiệp không bắt buộc phải đi kèm hạ tầng hyperscale. Bằng cách tái định hình kiến trúc xoay quanh bộ nhớ, TORmem mang lại hiệu năng suy luận cao, sẵn sàng cho production, đồng thời giúp doanh nghiệp tránh đầu tư quá mức vào những nền tảng GPU chuyên cho training.